Abstract

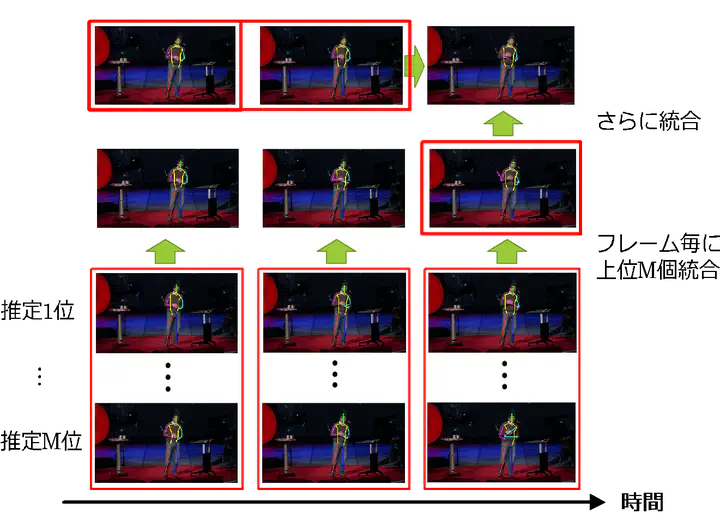

本研究では、カーネル密度推定を用いて1フレーム中の複数の姿勢候補を統合するだけでなく、動画の時間連続性を考慮して前後フレームの姿勢推定結果も統合することで、より高精度に人物の姿勢推定を行う方法を提案する。さらに、高速に一般物体検出を行うための手法であるFaster R-CNNを用いてフレーム中の人物位置の特定を行うことにより、処理の高速化を図る。提案手法の有効性を確認するためにTED講演会で行われた複数の講演の動画に対して2つの既存手法と提案手法による推定を行った。結果として、提案手法はおよそ60%の精度で、既存手法に比べて3.4%~5.0%高精度に人物の姿勢推定を行うことができ、処理速度はおよそ2倍になることを示した。

Type

Publication

In The 78th National Convention of IPSJ